Безопасность и риски внедрения ИИ: что важно знать бизнесу и обществу

Оглавление

- Технология современности

- Почему ИИ становится все более важным для бизнеса

- Основные категории рисков при внедрении ИИ

- Технические риски и угрозы безопасности

- Этические и социальные риски

- Юридические и регуляторные вызовы

- Как минимизировать риски внедрения ИИ

- Практические рекомендации для бизнеса

- Будущее безопасности в эпоху ИИ

- Заключение

Технология современности

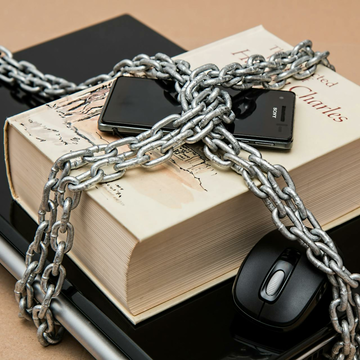

Искусственный интеллект — одна из самых революционных технологий современности, которая кардинально меняет бизнес, экономику и общество. Однако наряду с огромным потенциалом ИИ несёт и определённые риски, особенно связанные с безопасностью, этикой и законодательством. В этой статье мы подробно разберём, какие опасности могут сопровождать внедрение ИИ, как их распознать и как эффективно с ними работать.

Почему ИИ становится все более важным для бизнеса

ИИ помогает автоматизировать рутинные процессы, анализировать большие данные, предсказывать поведение клиентов и оптимизировать операции. Это делает компании более конкурентоспособными, гибкими и инновационными. Внедрение ИИ — уже не выбор, а необходимость для выживания и роста на рынке. Однако чем масштабнее использование ИИ, тем важнее учитывать все потенциальные риски.

Основные категории рисков при внедрении ИИ

Риски ИИ можно условно разделить на три большие категории:

- Технические риски и угрозы безопасности

- Этические и социальные риски

- Юридические и регуляторные вызовы

Каждая из них требует отдельного внимания и разработки мер защиты.

Технические риски и угрозы безопасности

Уязвимости и кибератаки

ИИ-системы часто зависят от сложных алгоритмов и большого объёма данных, что создаёт широкое поле для хакеров. Например, алгоритмы могут быть подвержены атакам, когда злоумышленники вводят «загрязнённые» данные, которые искажают работу модели.

Ошибки и сбои в работе ИИ

Если ИИ принимает решения в автоматическом режиме — ошибка алгоритма может привести к серьёзным последствиям. Например, неверная оценка кредитоспособности клиента или неправильное управление производственным процессом.

Потеря контроля и непрозрачность решений

Многие ИИ-модели — «чёрные ящики», когда даже разработчики не всегда могут объяснить, почему система приняла то или иное решение. Это создаёт риски неправильного использования и утраты контроля.

Этические и социальные риски

Дискриминация и предвзятость

Если данные для обучения ИИ не репрезентативны или содержат скрытые предвзятости, система может принимать дискриминационные решения. Например, отказывать в кредите определённым группам людей или неправильно оценивать сотрудников.

Нарушение приватности

Сбор и анализ огромного количества персональных данных создаёт угрозу нарушения конфиденциальности. Неправильное обращение с данными может привести к утечкам и нарушению прав пользователей.

Замена людей и социальные последствия

Автоматизация на базе ИИ может привести к сокращению рабочих мест и изменению социальных структур. Это требует адаптации общества и разработки новых моделей взаимодействия человека и машины.

Юридические и регуляторные вызовы

Отсутствие чётких нормативов

Законодательство в области ИИ пока отстаёт от технологий. Это создаёт неопределённость и риски для бизнеса — например, кто несёт ответственность за ошибку ИИ?

Ответственность и комплаенс

Компании должны соблюдать требования по защите данных (GDPR, локальные законы) и отвечать за безопасность пользователей. Невыполнение этих норм грозит штрафами и потерей доверия.

Как минимизировать риски внедрения ИИ

- Прозрачность алгоритмов: использование интерпретируемых моделей и объяснимого ИИ.

- Качество данных: контроль качества и актуальности данных для обучения моделей.

- Кибербезопасность: усиление защиты от внешних атак и внутреннего мошенничества.

- Этические стандарты: разработка и соблюдение принципов ответственного ИИ.

- Юридическая поддержка: сопровождение внедрения ИИ с учётом законов и нормативов.

Практические рекомендации для бизнеса

- Начинайте с аудита рисков: оцените, какие опасности есть в вашей сфере и конкретных задачах.

- Вовлекайте экспертов: привлекайте специалистов по безопасности, этике и праву.

- Обучайте сотрудников: понимание ИИ и его рисков — залог успешного внедрения.

- Внедряйте ИИ постепенно: тестируйте модели и проводите пилотные проекты.

- Создавайте обратную связь: система должна позволять исправлять ошибки и учитывать мнение пользователей.

Будущее безопасности в эпоху ИИ

ИИ продолжит развиваться, и вместе с этим будут появляться новые вызовы. Одновременно развиваются технологии защиты — от продвинутых систем мониторинга до этических рамок. Важна коллаборация между государством, бизнесом и обществом для создания безопасной и справедливой экосистемы ИИ.

Заключение

Внедрение искусственного интеллекта — это мощный инструмент для развития бизнеса и общества, но он сопровождается серьезными рисками и вызовами в области безопасности. Чтобы ИИ стал надежным помощником, а не угрозой, необходимо тщательно продумывать стратегии безопасности, этики и юридической ответственности.

Внимание к этим аспектам сегодня — залог устойчивого и успешного использования ИИ завтра.